Pipeline()-funktio on olennainen osa Transformer-kirjastoa. Se vaatii useita syötteitä, joissa voimme määritellä päättelytehtävän, mallit, tokenointimekanismin jne. Pipeline()-funktiota käytetään pääasiassa NLP-tehtävien suorittamiseen yhdelle tai useammalle tekstille. Se suorittaa esikäsittelyn syötteelle ja jälkikäsittelyn mallin perusteella tuottaakseen ihmisen luettavissa olevan tulosteen ja tarkan ennusteen maksimaalisella tarkkuudella.

Tämä artikkeli kattaa seuraavat näkökohdat:

Mikä on Hugging Face Dataset Library?

Hugging Face -tietojoukkokirjasto on API, joka sisältää useita julkisia tietojoukkoja ja tarjoaa helpon tavan ladata ne. Tämä kirjasto voidaan tuoda ja asentaa sovellukseen käyttämällä ' pip ”komento. Käytännön esittely Hugging Face -kirjaston tietojoukkojen lataamisesta ja asentamisesta on täällä Google Colab -linkki. Voit ladata useita tietojoukkoja osoitteesta Hugging Face Dataset Hub.

Lisätietoja pipeline()-funktion toiminnasta saat tästä artikkelista ' Kuinka käyttää Pipeline()-toimintoa muuntajissa? ”.

Kuinka käyttää putkia datajoukkoon Hugging Facessa?

Hugging Face tarjoaa useita erilaisia julkisia tietojoukkoja, jotka voidaan helposti asentaa käyttämällä yksirivistä koodia. Tässä artikkelissa näemme käytännön esittelyn putkien soveltamisesta näihin tietokokonaisuuksiin. On olemassa kaksi tapaa, joilla liukuhihnat voidaan toteuttaa tietojoukossa.

Tapa 1: Iterointimenetelmän käyttäminen

Pipeline()-funktiota voidaan iteroida myös tietojoukossa ja mallissa. Noudata tätä tarkoitusta varten alla olevia vaiheita:

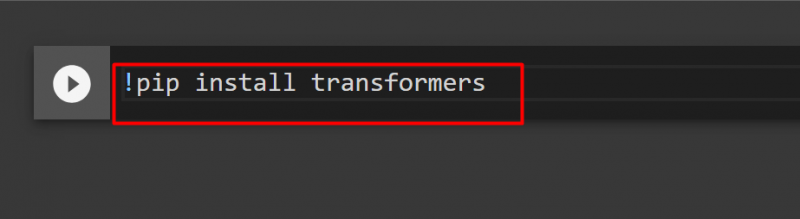

Vaihe 1: Asenna Transformer Library

Asenna Transformer-kirjasto antamalla seuraava komento:

!pip asennusmuuntajat

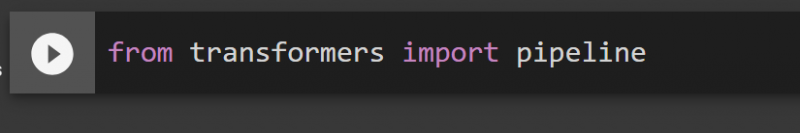

Vaihe 2: Tuo putkistoja

Voimme tuoda putkilinjan Transformer-kirjastosta. Anna tätä tarkoitusta varten seuraava komento:

muuntajien tuontiputkesta

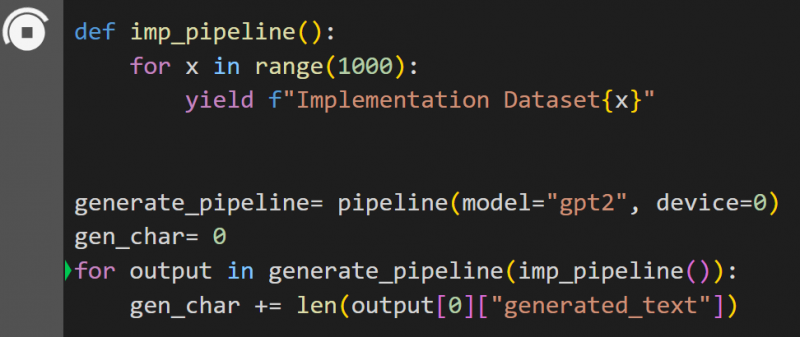

Vaihe 3: Ota putki käyttöön

Tässä pipeline()-funktio on toteutettu mallissa ' gpt2 ”. Voit ladata malleja osoitteesta Hugging Face Model Hub:

def imp_pipeline():x alueella (1000):

tuotto f'Toteutustietojoukko{x}'

gener_pipeline= putki(malli='gpt2', laite=0)

gen_char= 0

tulosta varten gener_pipeline(imp_pipeline()):

gen_char += len(tulostus[0]['generated_text'])

Tässä koodissa ' gener_pipeline ” on muuttuja, joka sisältää pipeline()-funktion mallilla ” gpt2 ”. Kun sitä kutsutaan ' imp_pipeline() ”-toiminto, se tunnistaa automaattisesti tiedot, jotka on kasvatettu arvoon 1000 määritetyllä alueella:

Tämän harjoittelu kestää jonkin aikaa. Linkki kohteeseen Google Co annetaan myös.

Tapa 2: Tietojoukkokirjaston käyttäminen

Tässä menetelmässä esittelemme liukuhihnan toteuttamisen käyttämällä 'tietojoukot' -kirjastoa:

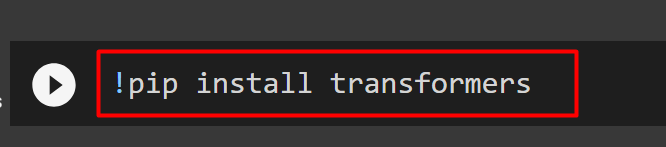

Vaihe 1: Asenna Transformer

Asenna Transformer-kirjasto antamalla seuraava komento:

!pip asennusmuuntajat

Vaihe 2: Asenna Dataset Library

Kuten ' tietojoukot ” kirjasto sisältää kaikki julkiset tietojoukot, voimme asentaa sen seuraavalla komennolla. Asentamalla ' tietojoukot ' -kirjasto, voimme tuoda minkä tahansa tietojoukon suoraan antamalla sen nimen:

!pip asennustietojoukot

Vaihe 3: Dataset Pipeline

Käytä seuraavaa koodia rakentaaksesi liukuhihnan tietojoukolle. KeyDataset on ominaisuus, joka tulostaa vain ne arvot, jotka kiinnostavat käyttäjää:

osoitteesta transformers.pipelines.pt_utils tuo KeyDatasetmuuntajien tuontiputkesta

tietojoukoista tuo load_dataset

gen_pipeline = putki(malli='hf-internal-testing/tiny-random-wav2vec2', laite=0)

loaddataset = load_dataset('hf-internal-testing/librispeech_asr_dummy', 'clean', split='validation[:10]') gen_pipeline(KeyDataset(loaddataset, 'audio')):

print('Tulostus nyt')

Tulosta ('----------------')

tulostaa (tulostus)

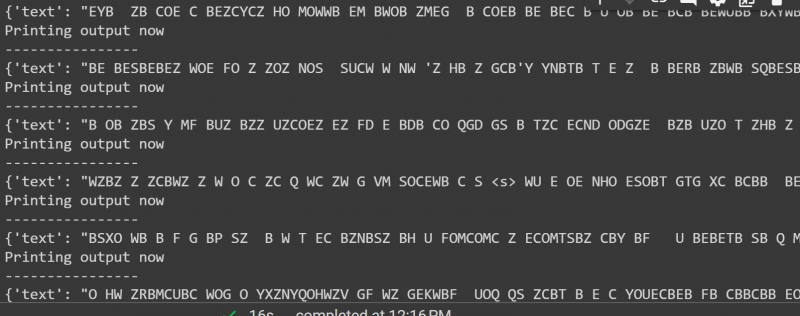

Yllä olevan koodin tulos on annettu alla:

Siinä kaikki tästä oppaasta. Linkki kohteeseen Google Co mainitaan myös tässä artikkelissa

Johtopäätös

Liukuputkien käyttämiseksi tietojoukossa voimme joko iteroida tietojoukon yli käyttämällä pipeline()-funktiota tai käyttää ' tietojoukot ' kirjasto. Hugging Face tarjoaa käyttäjilleen GitHub-arkistolinkin sekä tietojoukoille että malleille, joita voidaan käyttää vaatimusten mukaan. Tämä artikkeli on antanut kattavan oppaan putkien soveltamiseen Transformersin tietojoukossa.